وكيل الذكاء الاصطناعي (AI Agent) هو نظام برمجي قادر على إدراك بيئته، اتخاذ قرارات، وتنفيذ مهام بشكل مستقل باستخدام أدوات رقمية متعددة لتحقيق هدف محدد دون الحاجة إلى تعليمات خطوة بخطوة.

تخيّل أنك طلبت من مساعد رقمي حجز رحلة، وعدت بعد ساعة لتجد أنه لم يحجز الرحلة فحسب، بل راجع جدولك، و أرسل تأكيداً لعميلك، وعدّل اجتماعاً كان سيتعارض مع موعد المغادرة. أنت لم تطلب منه كل هذا. لم تعطِه تعليمات خطوة بخطوة. أعطيته هدفاً، وتركته يُنجزه الباقي .

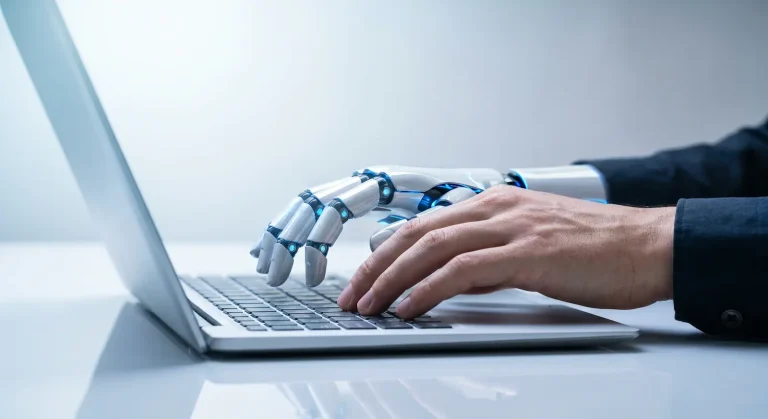

هذا ليس سيناريو مستقبلي. بل هو ما تفعله أنظمة وكلاء الذكاء الاصطناعي (AI Agent) اليوم في بيئات إنتاجية حقيقية داخل شركات حقيقية. والفرق بين هذا وبين ChatGPT و claude وغيرها من النماذج اللغوية التي تجيب على أسئلتك ليس فرقاً في الذكاء فقط ، بل فرق في الجوهر . فالنموذج اللغوي يُجيب. و الوكيل يتصرف.

فوكلاء الذكاء الاصطناعي ليسوا جيلاً أذكى من الشات بوت. فهم يشكلون تحوّل في العلاقة بين الإنسان والآلة، تحوّل تجاوز مرحلة الحديث ووصل إلى مرحلة الفعل. وفهم هذا التحوّل بات ضرورة لا ترفاً فكرياً.

ما الفرق بين النموذج اللغوي ووكيل الذكاء الاصطناعي؟

حين تكتب سؤالاً في ChatGPT أو claude وتحصل على إجابة، فأنت تتعامل مع نموذج لغوي في حالته الخام. النموذج يستقبل نصاً ويُنتج نصاً. ثم يبدأ من الصفر في كل محادثة، فهو لا يتذكر ما قبلها، و لا يتصرف خارج حدود النافذة المفتوحة أمامك، ولا يملك القدرة على تنفيذ شيء في العالم الخارجي. هو محرك استدلال وتوليد، لا أكثر.

ام وكيل الذكاء الاصطناعي فيختلف في البنية لا في الدرجة فقط .

فالتعريف الذي تبنّته OECD في تقريرها الصادر في فبراير 2026 : يصف الوكيل بأنه نظام يدرك بيئته ويعمل عليها بدرجة من الاستقلالية، مستخدماً الأدوات حسب الحاجة لتحقيق أهداف محددة. ما يبدو تعريفاً مؤسسياً جافاً يخفي تحوّلاً جوهرياً: الوكيل لا يجيب على سؤال، بل يُنجز المهمام كذلك .

فالفارق التقني بين الوكيل والنموذج اللغوي يكمن في أربع خصائص تجتمع ولا تنفصل.

- الاستقلالية: الوكيل قادر على العمل بحد أدنى من الإشراف البشري لتحقيق هدف نهائي. لا يحتاج إلى تعليمات خطوة بخطوة، بل يُقسّم الهدف بنفسه إلى مهام فرعية.

- التخطيط: حين تطلب من وكيل إعداد تقرير بحثي، فإنه لا يكتب مباشرةً. يُحدد أولاً ما يحتاج جمعه، يُرتّب تسلسل الخطوات، يُعيد التقييم حين تعترضه نتيجة غير متوقعة.

- استخدام الأدوات: الوكيل يستطيع استدعاء واجهات برمجية، تصفح الويب، تشغيل أكواد Python، وإرسال رسائل. النموذج اللغوي يكتب عن هذه الأشياء، الوكيل يفعلها.

- الذاكرة: على عكس النموذج اللغوي الذي يبدأ من صفحة بيضاء في كل جلسة، يحتفظ الوكيل بسياق يمتد عبر المهام. ذاكرة قصيرة المدى للمهمة الجارية، وأخرى بعيدة المدى تخزّن التفضيلات والمعرفة التنظيمية المتراكمة.

جوهر الفرق أن النموذج اللغوي “عديم الحالة” بطبيعته، يبدأ وينتهي. الوكيل “ذو حالة”، يعيش في حلقة مستمرة: يرصد، يفكر، يتصرف، يُقيّم النتيجة، يُعدّل المسار.

باختصار: النموذج اللغوي يجيب على الأسئلة، أما وكيل الذكاء الاصطناعي فيتخذ القرارات وينفذ المهام.

لماذا ظهر وكلاء الذكاء الاصطناعي الآن؟

الفكرة ليست جديدة. فالوكلاء المستقلون حلم قديم في أبحاث الذكاء الاصطناعي. ما تغيّر فقط هو أن النماذج اللغوية الكبيرة أصبحت قادرة على الاستدلال بجودة كافية لتكون “دماغاً” موثوقاً يُحرّك الوكيل، بينما توفّرت البنية التحتية اللازمة لتنفيذ القرارات في العالم الحقيقي.

AutoGPT كان الشرارة. حين ظهر في 2023 وأتاح لأي شخص تشغيل وكيل يعمل بصورة شبه مستقلة، ثم بعدها انفجر الاهتمام في مجتمعات المطوّرين. ليس لأنه كان مثالياً، بل لأنه أثبت أن المفهوم قابل للتنفيذ خارج المختبرات البحثية.

ما تلاه كان تطوراً في الأطر والأدوات. CrewAI طوّر نموذج “تنسيق الأدوار” حيث يعمل وكلاء متععددون كفريق منظّم: واحد يبحث، آخر يحلّل، ثالث يكتب. فقد أضاف إمكانية بناء تدفقات معقدة قابلة للتحكم والمراجعة عبر رسوم بيانية. AutoGen من Microsoft فتحا الباب أمام محادثات بين وكلاء متعددين يتعاونون على حل مشكلة واحدة. وواجهة OpenAI Assistants API أتاحت للمطوّرين بناء وكلاء مدمجون في تطبيقاتهم مع إدارة تلقائية للذاكرة وأدوات مثل مترجم الكود.

و في أبريل 2026، أطلقت Anthropic “Claude Managed Agents” لمعالجة إشكالية البنية التحتية: كيف تُدار هوية الوكيل، كيف تُعزل بيئات تنفيذه، كيف تُراقَب قراراته. هذا التطور يكشف أن الصناعة انتقلت من مرحلة “هل يمكن للوكيل أن يعمل؟” إلى مرحلة “كيف نجعله يعمل بأمان وموثوقية في بيئات إنتاجية حقيقية؟”

كما ان تقرير LangChain حول “حالة وكلاء الذكاء الاصطناعي” الصادر عام 2026 يرصد النتيجة نتيجة صادمة ولكنها متوقعة في ظل ماتشهده هذه النماذج من تطور : 57 بالمئة من المؤسسات لديها وكلاء في مرحلة الإنتاج الفعلي. ليس مرحلة تجارب، بل الإنتاج فعلي.

مثال بسيط: يمكن لوكيل ذكاء اصطناعي في شركة تجارة إلكترونية أن يراقب المخزون، يطلب شحنة جديدة من المورد، ويرسل تنبيهاً إلى فريق المبيعات دون تدخل بشري مباشر.

من يربح ومن يخسر: الاقتصاد السياسي للوكلاء

هذا وحده يكفي لفهم لماذا باتت الشركات الكبرى تُضخّ استثمارات ضخمة في هذا الاتجاه.

وفق تقديرات Gartner، ستتضمن 40 بالمئة من التطبيقات المؤسسية وكلاء مدمجين بحلول نهاية 2026. Salesforce وWorkday بدآ بالفعل دمج “الموظفين الرقميين” في أنظمة إدارة الموارد البشرية وعلاقات العملاء. القطاع المالي يستخدم الوكلاء في مطابقة الفواتير والتحقق من الامتثال الضريبي وتسوية الحسابات آلياً. في بحث مرض ألزهايمر، يعمل وكيل “Co-scientist” على توليد الفرضيات وتحليل البيانات الضخمة وتصميم التجارب.

لكن المشهد الاقتصادي لا يُقرأ بالأرقام فقط.

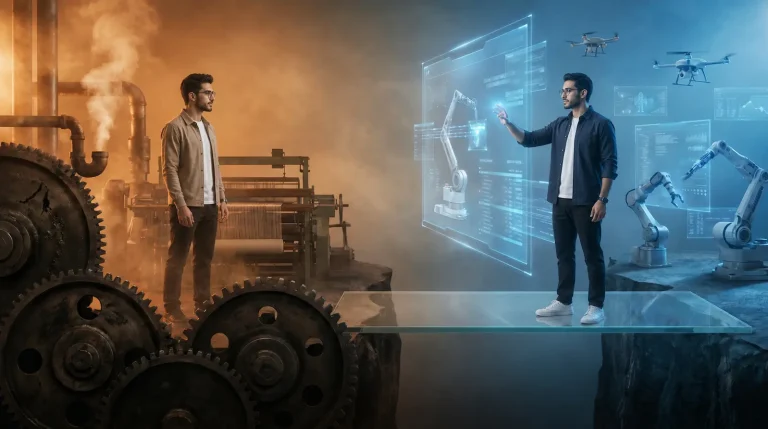

الوكيل الذكي يُعيد توزيع الأدوار الإنتاجية بصورة مختلفة عما فعله الذكاء الاصطناعي التوليدي. النموذج اللغوي تحدّى المحتوى النصي والصوري. الوكيل يتحدى العمليات: العمل الإداري المتكرر، التنسيق بين الأنظمة، متابعة المهام المتسلسلة، إدارة المعلومات عبر منصات متعددة. هذه هي الوظائف التي يشغلها أكبر شريحة من القوى العاملة في الاقتصادات الخدمية.

المستفيد الأول هو من يملك القدرة على نشر هذه الوكلاء وتوجيهها: الشركات الكبرى التي تستطيع الاستثمار في البنية التحتية والكوادر المتخصصة. المتضرر الأول هو العمل الروتيني المتكرر بصرف النظر عن مستواه التعليمي. الذكاء الاصطناعي وسوق العمل ليسا معادلة بسيطة بوظائف تختفي وأخرى تظهر، بل هما إعادة رسم لحدود ما يحتاج الإنسان فعله وما يمكن تفويضه.

مخاطر وكلاء الذكاء الاصطناعي؟

السؤال الحقيقي هو: ماذا يحدث حين يتصرف الوكيل بصورة خاطئة في بيئة إنتاجية حقيقية تترتب عليها عواقب؟

ورقة DeepMind “AI Agent Traps” الصادرة في أبريل 2026 وثّقت كيف نجحت هجمات “حقن المحتوى” في التلاعب بقرارات الوكلاء المستقلة بنسبة 86 بالمئة. الوكيل يُصدر قرارات تلقائية استناداً إلى ما يراه ويقرأه، وإذا كان ما يراه مُحرَّفاً فقراراته ستكون مُحرَّفة بدورها.

أضف إلى ذلك أن الوكلاء أكثر كلفة من النماذج التقليدية لأن كل مهمة تستلزم عشرات المكالمات للنموذج في حلقات متتالية. 32 بالمئة من الشركات ترى في “الجودة” العائق الأكبر أمام التوسع، وفق البيانات المتاحة، بينما تعتبر 85 بالمئة من الفرق الهندسية أن صيانة استقرار الوكلاء هي التحدي الرئيسي.

هذه ليست عقبات تقنية عابرة. هي أسئلة حوكمة أعمق: من المسؤول حين يتصرف الوكيل خطأ؟ المطوّر؟ المشغّل؟ المستخدم؟ من يتحمل المسؤولية القانونية عندما تخطئ الخوارزمية سؤال لم يُحسم بعد في أي منظومة قانونية على مستوى العالم، وانضمام الوكلاء إلى المشهد يُعقّد الإجابة أكثر.

المنطقة العربية: سباق مبكر بمخاطر مفتوحة

ما يحدث في المنطقة العربية يستحق قراءة منفصلة لأنه يكسر النمط المألوف من الاستيراد التكنولوجي المتأخر.

في فبراير 2026، أطلقت وزارة التجارة والصناعة القطرية بالتعاون مع مايكروسوفت “مصنع وكلاء الذكاء الاصطناعي”، منصة لإنتاج وإدارة وكلاء رقميين لأتمتة الخدمات الحكومية. في الشهر نفسه أطلقت وزارة الاتصالات القطرية منصة “كاي” كبنية تحتية وطنية لتمكين الجهات الحكومية من إطلاق وكلاء متطورين.

السعودية تتحرك بوتيرة مختلفة. في أبريل 2026، أعلنت شركة “Humain” المدعومة من صندوق الاستثمارات العامة عن شراكة لإطلاق أول سوق عالمي لوكلاء الذكاء الاصطناعي للمؤسسات. افتتاح مركز بيانات “Hexagon” بسعة 480 ميجاواط يوفّر القدرة الحوسبية اللازمة لتشغيل أنظمة وكلاء متعددة على نطاق واسع. الإمارات خصصت 13 مليار درهم لاستراتيجية التحول الرقمي 2025-2027 مع تركيز صريح على أتمتة 100 بالمئة من العمليات الحكومية عبر حلول الوكلاء.

في القطاع المصرفي الخليجي، بدأت بنوك في الإمارات والسعودية والبحرين توظيف الوكلاء في كشف الاحتيال والتحقق من الهوية ومعالجة القروض بصورة مستقلة، مُقلِّصةً زمن المراجعة من أيام إلى دقائق.

لكن ثمة تحدٍّ بنيوي يختص بالمنطقة ولا يمكن تجاوزه بالاستثمار وحده. نموذج “فنار” القطري يمثّل إنجازاً في دعم الوكلاء باللغة العربية، لكنه يكشف في الوقت ذاته هشاشة الاعتماد على نماذج مُصمَّمة لسياقات لغوية وثقافية مختلفة. 50 بالمئة من المؤسسات الإقليمية تُشير إلى نقص الكوادر المتخصصة بوصفه عائقاً أمام التوسع، وفق تقارير 2025. والتوجه نحو “الذكاء الاصطناعي السيادي” لضمان بقاء البيانات الحساسة داخل الحدود الوطنية يعكس وعياً بمخاطر الاعتماد الخارجي، لكنه يزيد التكلفة ويُعقّد المسار.

المنطقة تتحرك مبكراً هذه المرة. لكن السرعة في النشر دون بناء كوادر قادرة على فهم هذه الأنظمة وحوكمتها ومراجعتها قد تُنتج اعتماداً من نوع جديد لا يختلف في جوهره عن الاعتماد القديم.

الوكيل كمرحلة: ما الذي يتغير فعلاً؟

Sam Altman وصف عام 2025 بأنه “عام الوكلاء”. Demis Hassabis من Google DeepMind يرى أن الوكلاء يُمثّلون خطوة جوهرية نحو الذكاء الاصطناعي العام. Jensen Huang من NVIDIA يُشير إلى أن مراكز البيانات الجديدة تُبنى أساساً لخدمة “مصانع الوكلاء” لا مجرد النماذج اللغوية.

ما يجمع هؤلاء هو قناعة أن الوكلاء ليسوا تحسيناً للنماذج القائمة، بل تحولاً في طريقة تعامل الآلة مع العالم. النموذج اللغوي يُجيب. الوكيل يتصرف.

هذا التمييز له وزن فلسفي قبل أن يكون تقنياً. حين تُجيب الآلة، المسؤولية على من طرح السؤال. حين تتصرف الآلة، المسؤولية أقل وضوحاً وتوزيعاً بكثير.

التاريخ يعرف هذا النمط. كل تقنية تُزيح الإنسان خطوة عن مركز القرار تُنتج موجة من الكفاءة وموجة موازية من الأسئلة التي لا تملك المنظومات القانونية والاجتماعية إجاباتها بعد. البخار أنتج المصنع وأنتج معه سؤال حقوق العمال. الكهرباء أنتجت الشبكة وأنتجت معها سؤال الاحتكار. الإنترنت أنتج الاقتصاد الرقمي وأنتج معه سؤال السيادة على البيانات.

الوكيل الذكي يطرح السؤال التالي: حين تتصرف الآلة نيابةً عنك بشكل مستقل وتُنتج عواقب حقيقية، أين تبدأ مسؤوليتها و تنتهي مسؤوليتك؟

لا أحد يملك الإجابة بعد. وهذا بالضبط ما يجعل هذه المرحلة مقلقة ومثيرة في آنٍ معاً.