حين قررت وزارة تعليم في دولة عربية اعتماد منصة تعليمية تعمل بالذكاء الاصطناعي لتقييم أداء الطلاب وتوجيههم أكاديميًا، لم تسأل سؤالًا بدا لها غير ضروري: على أي بيانات دُرّب هذا النظام؟ وما المعايير التي يستخدمها ليُصنّف طالبًا “متفوقًا” وآخر “يحتاج دعمًا”؟ اضرب هذا المثال باسم دولة موجودة وليس بالضروري ان تكون عربية يكفي ان تكون مسلمة او ذات اغلبية مسلمة

المثال العربي ليس استثناءً. إنه نمط موجود وواقع ملموس.

لم تُطرح هذه الأسئلة لأن المنصة جاءت جاهزة ومغلّفة بكفاءة تقنية لا تُنكر. لكن التجربة ليست بلا سوابق تُنذر. فداخل الولايات المتحدة مثلا أثار نظام COMPAS لتقييم مخاطر الجريمة جدلًا واسعًا بعد تحقيق أجرته ProPublica عام 2016 كشف أن الخوارزمية كانت تميل إلى تصنيف المتهمين السود على أنهم أكثر خطورة مقارنة بالبيض في ظروف متشابهة. فإذا كان هذا يحدث داخل المنظومة التي أنتجت الخوارزمية وأمام نظام قانوني يملك آليات رقابة، فماذا يحدث حين تُنقل هذه الأنظمة إلى سياقات لا تملك حتى أدوات الكشف عما تفعله خوارزمياتها داخليًا؟

الذكاء الاصطناعي في العالم الإسلامي حاضر بقوة كأداة استهلاك. الحكومات تشتريه والشركات تستخدمه والمواطنون يتفاعلون معه يوميًا. لكن المسافة بين استهلاك التقنية وإنتاجها ليست فجوة تُردم بالشراء. هي بنية تبعية تُعيد إنتاج نفسها.

ما الذي يدخل مع التقنية المستوردة

كل نموذج ذكاء اصطناعي يحمل داخله تصورات محددة عن العالم. وفق ما يُظهره مؤشر Stanford للذكاء الاصطناعي الصادر عام 2024، تستأثر النماذج الكبرى ببيانات تدريب ذات أغلبية إنجليزية واضحة، وهو ما يُنشئ انحيازًا لغويًا وثقافيًا بنيويًا يتجاوز مجرد ضعف الأداء بلغات أخرى. والولايات المتحدة والصين وبريطانيا تستأثر بمعظم الأبحاث المنشورة عالميًا في هذا المجال بينما لا تظهر أي دولة ذات أغلبية مسلمة ضمن العشر الأوائل.

الانحياز اللغوي ليس المشكلة الوحيدة. التصورات المضمّنة في النماذج عن السلوك “الطبيعي” و”المنحرف”، وعن العدالة والتحيز، وعن ما هو “مقبول” و”ضار”، تشكّلتها نقاشات أمريكية وأوروبية لا علاقة لها بالسياق العربي أو الإسلامي. وهذه التصورات لا تختفي حين تُشغَّل الخوارزمية في الرياض أو القاهرة. تعمل بصمت وتُنتج قرارات تبدو محايدة لكنها محمّلة بسياق ثقافي لم يُفحص.

نظام تقييم ائتماني دُرّب على بيانات مستهلكين أمريكيين ثم طُبّق في بنك عربي لا يُقيّم العميل بمعايير محلية. يُقيّمه بمعايير أمريكية أُعيد تغليفها. أن تملك بياناتك لا يعني أنك تملك قرارك إن كان من يُعالجها يفكر بمنطق مجتمع مختلف تمامًا. وهذا ليس خللًا تقنيًا يُصلح بتحديث برمجي. هو نقل ثقافي وقانوني وأخلاقي يحدث دون أن يُسمّيه أحد.

نمط قديم بأدوات جديدة

التبعية التقنية ليست اختراعًا رقميًا. العالم الإسلامي عرف هذا النمط قبل الذكاء الاصطناعي بعقود.

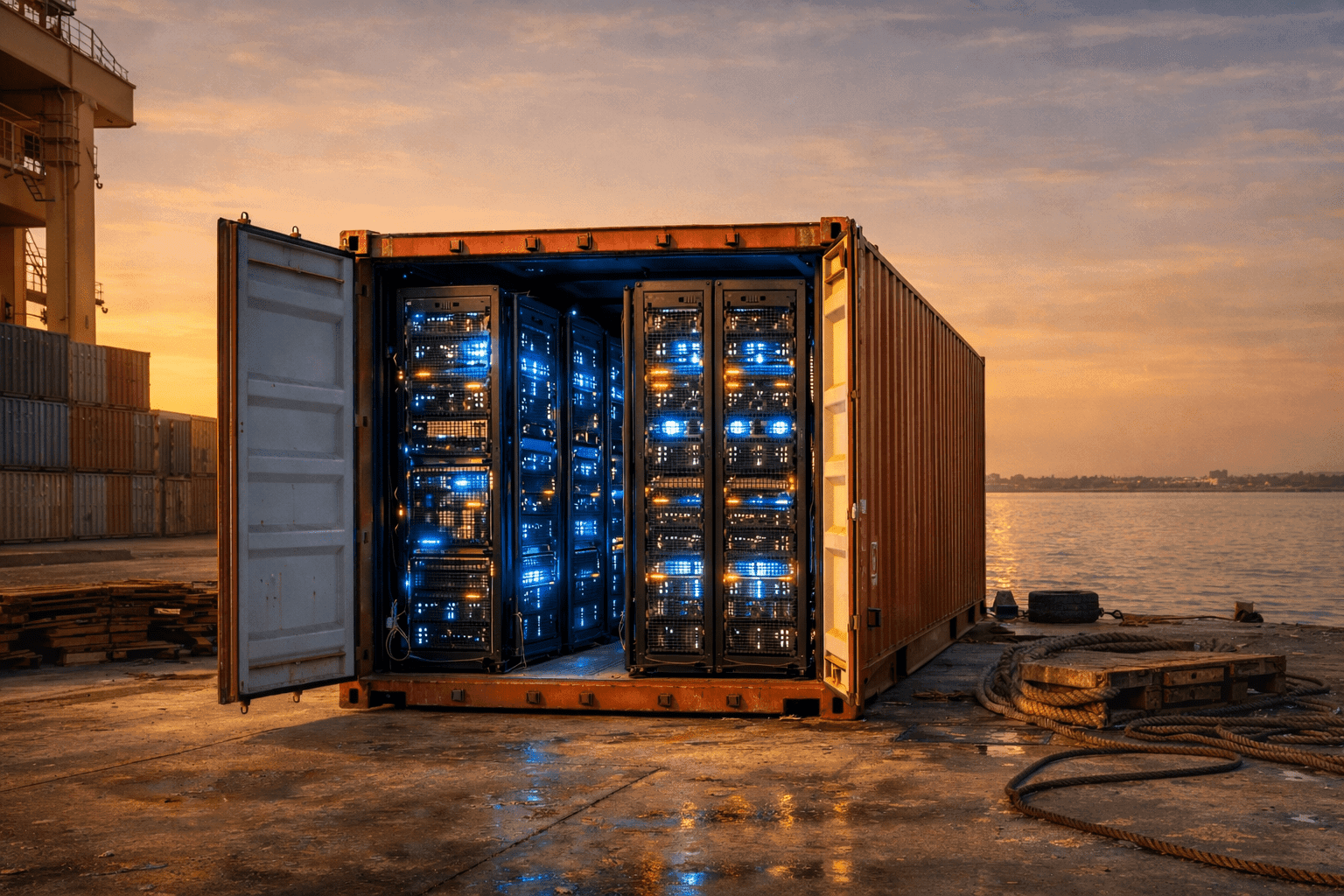

في الستينيات والسبعينيات، استوردت دول عربية كثيرة مصانع كاملة جاءت “مفتاحًا بيد” أي جاهزة للتشغيل دون أن تملك الدولة المستوردة القدرة على صيانتها أو تطويرها. النتيجة دورة تتكرر: تقنية تعمل لسنوات ثم تتقادم فلا أحد يستطيع تحديثها فتُستورد نسخة جديدة وتبدأ الدورة من جديد.

الذكاء الاصطناعي يُعيد هذا النمط بخطورة مضاعفة. المصنع القديم كان يُنتج سلعة مادية يمكن فحصها بالعين المجردة. أما النموذج الذكي فيُنتج قرارات غير مرئية مبنية على منطق مخفي حتى عن مشغّليه أحيانًا. وحين يُخطئ المصنع يتوقف الإنتاج ويُرصد العطل. أما حين تُخطئ الخوارزمية فالضرر يتوزع على آلاف الأفراد دون أن يشعر أحد بأنه وقع. و قضية COMPAS أثبتت ذلك في سياق أمريكي يملك نظامًا قانونيًا قويًا وأدوات رقابة إعلامية. فما بالك حين تُنقل أنظمة مماثلة إلى سياقات عربية لا تملك حتى آليات الكشف والمساءلة التي كشفت المشكلة هناك أصلًا؟

الاستثناء الخليجي: إنجاز بلا عمق

يُقدَّم النموذج الخليجي عادةً كاستثناء يكسر قاعدة الاستهلاك. والإنجاز حقيقي ولا يصح التقليل منه.

معهد الابتكار التكنولوجي في أبوظبي أطلق نموذج Falcon الذي نافس وقت صدوره نماذج مفتوحة المصدر من شركات أمريكية. والسعودية أطلقت ALLaM كنموذج لغوي مصمّم للعربية. وهذان النموذجان أبرزان أن دولًا عربية قادرة على المنافسة حين تقرر ذلك.

لكن الفرق بين الإنجاز والسيادة لا يُقاس بالمؤتمرات. فريق Falcon ضمّ باحثين من جنسيات عدة أغلبهم مستقطبون من الخارج. والخبرة التي أنتجت النموذج لم تتشكّل داخل المنظومة التعليمية الإماراتية بل استُقطبت من جامعات ومختبرات غربية. السؤال المباشر: إذا غادرت هذه الكفاءات غدًا فهل تملك المؤسسة المحلية القدرة على الاستمرار بنفس المستوى؟

الاستقطاب ليس خطأ. كل الدول التي بنت قدرات تقنية حقيقية بدأت به. لكنها استخدمته كمرحلة انتقالية لا كنهاية. الصين وكوريا الجنوبية أنشأتا جامعات بحثية ودرّبتا أجيالًا حلت تدريجيًا محل المستقطبين. في الخليج لم يتضح بعد أن هذا الانتقال يسير بالوتيرة الكافية.

وALLaM نموذج سعودي لكنه جاء بشراكة مع شركة IBM الأمريكية. الشراكات أداة مشروعة لكنها تعني أن جزءًا من البنية التقنية والمعرفية يبقى خاضعًا لطرف خارجي. والسيادة المبنية على شراكات دائمة دون بناء قدرة مستقلة موازية تبقى سيادة منقوصة مهما بدت مبهرة.

الثقل الديموغرافي بلا ثقل تقني

الخليج بكل استثماراته يمثّل شريحة صغيرة سكانيًا. الثقل الحقيقي في مصر وباكستان وبنغلاديش وإندونيسيا ونيجيريا وتركيا. مئات الملايين من الشباب وجامعات كثيرة وكفاءات أثبتت نفسها عالميًا.

لكن ما يبقى داخل هذه البلدان من الطاقة لا يكفي لتشكيل كتلة حرجة. تونس تُخرّج مهندسين يتنافس عليهم سوق العمل الفرنسي. مصر تُنتج باحثين يتصدرون فرقًا بحثية في كندا وألمانيا. باكستان تملك قاعدة واسعة من مطوّري البرمجيات يعملون عن بُعد لصالح شركات غربية. لكن هذه الكفاءات تعمل لخدمة منظومات أخرى لا لبناء منظومتها. والمؤسسات في بلدانها لا تملك ما يُغريها به: لا رواتب منافسة ولا بيئة بحثية ولا مشاريع طويلة الأمد.

النتيجة أن هذه الدول تُصدّر المادة الخام البشرية وتستورد المنتج التقني الجاهز. تمامًا كما كانت تُصدّر النفط خامًا وتستورده مشتقات. المادة اختلفت والبنية واحدة.

وحين أصدرت اليونسكو عام 2021 توصيتها بشأن أخلاقيات الذكاء الاصطناعي وهي أول صك معياري عالمي في هذا الملف، دعت صراحة إلى ضمان التنوع الثقافي واللغوي في تطوير الذكاء الاصطناعي وإلى بناء قدرات محلية في الدول النامية. التوصية ليست ملزمة. لكن غياب أي ضغط مؤسسي يُفعّلها يجعلها مجرد حبر على ورق.

حين يتولى الغير مهمة التشريع

حين تغيب القدرة الإنتاجية المحلية يحدث ما هو أخطر من التبعية التقنية.

شركات مثل Google وMeta وOpenAI لا تبيع خدمات تقنية فقط. بل تفرض من خلال منتجاتها معايير أخلاقية وثقافية ولغوية تسري على كل مستخدم بصرف النظر عن سياقه. ما تعتبره هذه الشركات “محتوى ضارًا” أو “تحيزًا يجب تصحيحه” مبني على نقاشات داخلية أمريكية. ومع ذلك يسري على مئات الملايين من المستخدمين العرب والمسلمين الذين لم يشاركوا في صياغة تلك المعايير ولا يملكون أدوات تغييرها.

من لا يُنتج النموذج لا يملك حق تعديل قواعده. يستهلك التقنية كما تأتي ويتكيف مع معاييرها لا العكس. وهذا شكل من أشكال فقدان السيادة لم تعرفه الدول في عصر الصناعة التقليدية، لأن المصنع القديم كان يُنتج سلعة يستخدمها المشتري بالطريقة التي يريدها. أما النموذج الذكي فيُنتج قرارات ومعايير يتبناها المستخدم دون أن يدري أنه يتبنّى ثقافة مصدرها لا تقنيتها فقط.

ما الذي يمكن فعله

الحل ليس في التوقف عن الاستخدام بل في الانتقال من استهلاك أعمى إلى استهلاك واعٍ.

كل نظام يُستورد لقطاع حساس يجب أن يخضع لتقييم محلي مستقل يفحص تحيزاته الثقافية واللغوية. ليس تقييمًا تقنيًا فحسب بل مراجعة تكشف ما إذا كانت المعايير المضمنة تصلح للسياق أم لا. وهذه الخطوة لا تحتاج بناء نموذج من الصفر بل كفاءة كافية للفحص والتعديل.

والاستثمار في نماذج لغوية عربية مفتوحة المصدر ضرورة لا رفاهية. العربية بلهجاتها والسياقات القانونية الإسلامية لا تمثّلها نماذج دُرّبت على إنجليزية بالأساس. وهذا ما يجعل أخطاء الخوارزميات في السياق العربي ليست أخطاء تقنية فقط بل أخطاء بنيوية في التمثيل والتشبع.

والأهم وقف نزيف الكفاءات. لا بخطابات وطنية بل ببيئة بحثية حقيقية وميزانيات مستدامة على عقود ومؤسسات تملك صلاحيات حقيقية واستقلالية كاملة. الدول التي بنت قدرات تقنية حقيقية فعلت ذلك بالاستثمار المستمر لا بالخطب.

ان ما يُعاد تشكيله اليوم ليس سوق التقنية. ببل هي بنية القرار في المجتمعات. و العالم الإسلامي يستهلك هذه المنظومة بكثافة لكنه لا يسأل بعد السؤال الذي يفرضه الواقع: ماذا تفعل بنا هذه التقنية بينما نظن أننا من يستخدمها؟

إن أتت الإجابة فستأتي من هنا. أو لن تأتي.

المراجع المستخدمة في المقال

- Stanford AI Index Report 2024

- تحقيق ProPublica عن نظام COMPAS (2016)

- توصية اليونسكو بشأن أخلاقيات الذكاء الاصطناعي (2021)