في دول عربية عدة، تعتمد منصات توظيف رقمية على خوارزميات فرز آلي تُصنّف المتقدمين وترفض بعضهم قبل أن يطّلع على ملفاتهم إنسان واحد. المتقدم المرفوض لا يعرف السبب الحقيقي. والشركة المشغّلة لا تستطيع في كثير من الأحيان أن تفسّر لماذا قررت الخوارزمية ما قررته. أما القانون فلا يمنح هذا الشخص أي مسار واضح للاعتراض.

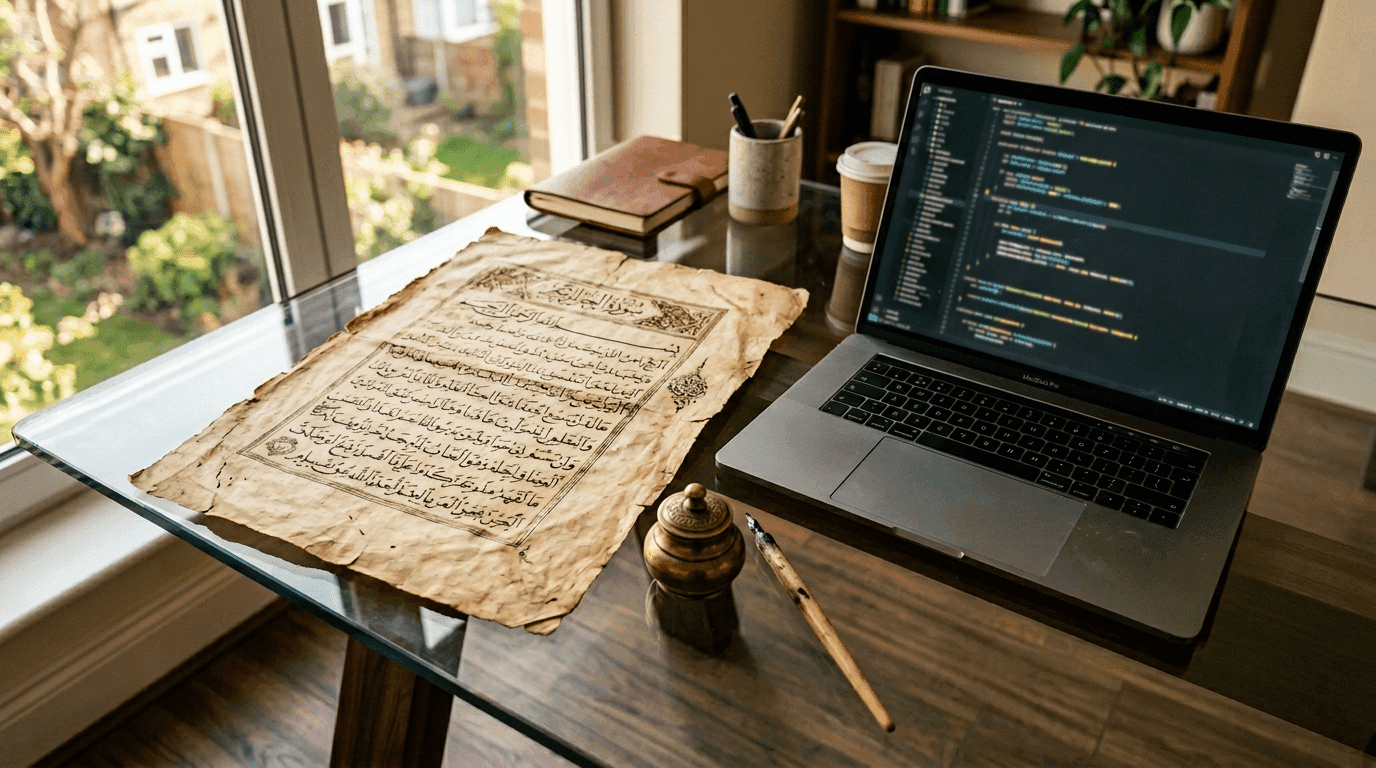

ليست القصة جديدة تمامًا. فالفقه الإسلامي واجه قبل قرون تقنيات لم يعرفها من قبل وأنتج لها أدوات. لكن الفارق هذه المرة أن القرار الآلي لا يمنح أحدًا رفاهية التأخر.

بين النص والنظام فجوة تتسع

الفقه الإسلامي والذكاء الاصطناعي يظهران معًا في ندوات ومؤتمرات كثيرة. لكن ما لا يظهر هو نص تشريعي واحد ملزم خرج من كل هذا النشاط.

فالهيئة السعودية للبيانات والذكاء الاصطناعي (سدايا) التي أُنشئت عام 2019 أصدرت نظام حماية البيانات الشخصية بموجب المرسوم الملكي رقم م/19 لعام 2021 والمعدّل في مارس 2023. خطوة مهمة بلا شك. لكنها تعالج البيانات لا الذكاء الاصطناعي نفسه. لا يوجد فيها ما يُلزم بالإفصاح عن آلية القرار الآلي ولا ما يمنح المتضرر حقًا صريحًا في الطعن. والإمارات التي عيّنت وزير دولة للذكاء الاصطناعي عام 2017 وأطلقت استراتيجية وطنية تمتد حتى 2031 لا تزال تبني إطارها التنظيمي قطعة قطعة دون أن يكتمل بعد. مصر نشرت استراتيجيتها الوطنية للذكاء الاصطناعي عام 2019 لكنها وثيقة رؤية لا قانون. أما الأردن وتونس والمغرب فلا يملك أي منها تشريعًا مخصصًا لهذا الملف.

في المقابل، احتاج الاتحاد الأوروبي سنوات من النقاش البرلماني والتقني ليُقرّ رسميًا في مارس 2024 قانون الذكاء الاصطناعي الذي يُصنّف الأنظمة حسب درجة خطورتها ويفرض متطلبات شفافية وتدقيق مسبق على الأنظمة عالية المخاطر. القانون ليس مثاليًا وانتقده كثيرون بأنه بطيء وبيروقراطي. لكنه على الأقل يطرح الأسئلة الثلاثة التي لم تُطرح بعد بشكل مؤسسي في أي دولة عربية: ما حقوق المتضرر؟ من يتحمل المسؤولية؟ وكيف يُفحص التحيّز قبل الإطلاق؟

الفارق ليس في سرعة التشريع فحسب. بل في وجود النقاش أصلًا. في بروكسل كان السؤال: كيف ننظّم؟ في أغلب العواصم العربية والإسلامية، السؤال لم يُطرح بعد خارج أروقة الأكاديميا.

أنظمة تعمل بلا رقيب

هذا ليس كلامًا نظريًا. فالأنظمة تعمل فعلًا على الأرض وتتخذ قرارات يومية تمس أفرادًا حقيقيين.

في السعودية، تعتمد شركات الاتصالات والبنوك على نماذج تقييم ائتماني تحلل السلوك الرقمي للأفراد لتقرير أهليتهم للقروض. شركة سمة للمعلومات الائتمانية تُدير قاعدة بيانات ائتمانية واسعة يُرجع إليها أغلب المقرضين. لكن المعايير الدقيقة التي تستخدمها الخوارزميات في تصنيف العملاء ليست شفافة ولا خاضعة لتدقيق مستقل منشور. من رُفض طلب قرضه بناءً على تصنيف آلي لا يعرف تحديدًا لماذا رُفض، ولا يملك أداة قانونية للمطالبة بتفسير.

وفي الإمارات، أعلنت هيئة الهوية والجنسية اعتمادها أنظمة بوابات ذكية في المطارات تستخدم التعرف على الوجوه. التقنية أثبتت كفاءتها في تسريع الإجراءات. لكن ماذا يحدث حين يُرفض مسافر أو يُوقف بناءً على خطأ في التعرف الآلي؟ لا يوجد نص تشريعي إماراتي منشور يحدد حقوقه في هذه الحالة أو يُلزم الجهة المشغّلة بمراجعة بشرية فورية.

وفي مصر، بدأت بنوك تجارية تستخدم نماذج تقييم آلي في قرارات الإقراض. العميل الذي يُرفض طلبه يتلقى رسالة اعتذار مقتضبة. لا تفسير ولا مسار اعتراض ولا التزام قانوني على البنك بأن يشرح ما حدث داخل النظام.

كل هذه الأنظمة تعمل. لكنها تعمل في فراغ تشريعي كامل.

ما يجعل هذا الفراغ أخطر من سابقيه أن القرار الآلي يمتاز بثلاث خصائص لم تكن موجودة في التقنيات السابقة. أولاها السرعة، إذ يُصدر آلاف القرارات في دقائق. وثانيتها الغموض، فحتى المشغّل أحيانًا لا يستطيع تفسير قرار النموذج. وثالثتها التوسّع، إذ ينتقل النظام من قطاع إلى آخر بسرعة تفوق قدرة أي مشرّع على الملاحقة.

الفقه ليس عاجزًا لكنه بطيء

يملك الفقه الإسلامي أدوات لو أُحسن توظيفها لصلحت كنقطة انطلاق جادة لا كإطار مكتمل.

مبدأ “لا ضرر ولا ضرار” الذي أصّله حديث نبوي وتبنّته المذاهب الأربعة كقاعدة كلية يمكن نظريًا أن يؤسس لمساءلة عن أضرار القرار الآلي. ومبدأ المقاصد الشرعية الخمسة الذي صاغه الشاطبي في “الموافقات” يصلح كإطار تقييم أخلاقي. وقاعدة “درء المفاسد مقدّم على جلب المصالح” تمنح مساحة للموازنة بين فائدة التقنية وأضرارها المحتملة. بل إن قاعدة “التصرف على الرعية منوط بالمصلحة” تُقدّم أساسًا فقهيًا صريحًا لمطالبة الدولة بتنظيم التقنية حين تضر بالناس.

لكن بين المبدأ والتطبيق مسافة كبيرة.

كيف تُترجم “لا ضرر” إلى معيار تقني لقياس تحيّز خوارزمية توظيف رفضت متقدمًا لأن بياناته تُشبه فئة ديموغرافية صُنّفت سلفًا كـ”عالية المخاطر”؟ المبدأ يقول: لا ضرر. لكنه لا يقول كيف تُحدد أن ضررًا وقع أصلًا حين يكون القرار مخبأ داخل نموذج رياضي لا يقرأه إلا متخصص. ومن يملك صلاحية الاجتهاد في مسألة يفتقر فيها أغلب الفقهاء إلى الفهم التقني ويفتقر فيها أغلب المهندسين إلى الوعي الفقهي والقانوني؟

هذه ليست أسئلة افتراضية. هي أسئلة عالقة في المسافة بين المنبر والمختبر.

تاريخيًا، واجه الفقه لحظات مشابهة وتعامل معها بنمط يتكرر: بطء ثم تأطير متأخر. الطباعة تأخر قبولها قرونًا بسبب مقاومة مؤسسية مرتبطة بمصالح اقتصادية لا بموقف فقهي صريح. والمعاملات المالية الحديثة مرّت بمسار رفض فنقاش فتأطير أنتج في نهاية المطاف أدوات عملية لا تزال تعمل في المصرفية الإسلامية حتى اليوم. لكن تلك التقنيات كانت تتحرك ببطء يمنح الفقه وقتًا للّحاق. الذكاء الاصطناعي لا يمنح هذا الوقت. قراراته فورية وأضراره تتراكم قبل أن يبدأ النقاش.

ثلاث مؤسسات لا تتحدث نفس اللغة

لو كانت المشكلة فقهية فقط لكانت أبسط. المشكلة الفعلية أن ثلاث مؤسسات تعمل في مسارات منفصلة لا تتقاطع.

المؤسسة الدينية تتحدث بلغة المقاصد والمصالح المرسلة. المؤسسة التشريعية تتحدث بلغة النصوص والمواد القانونية. والمؤسسة التقنية تتحدث بلغة البيانات والنماذج الرياضية. مجمع الفقه الإسلامي الدولي التابع لمنظمة التعاون الإسلامي ناقش في دوراته الأخيرة مواضيع تتعلق بالتقنية والمعاملات الرقمية وأصدر قرارات فيها. لكنها قرارات ذات طابع توصيفي لا إلزامي، لا تملك قوة القانون ولا تصل إلى الجهة التي تُشغّل الخوارزمية فعلًا.

وجامعات عربية نظّمت ملتقيات كثيرة جمعت بين الشريعة والتكنولوجيا في عناوينها. لكن أوراقها البحثية تبقى داخل أسوار الأكاديميا. لا تصل إلى يد المشرّع ولا تُترجم إلى صياغة قانونية ولا يسمع بها المهندس الذي يبني النظام الذي سيتخذ القرار.

الحصيلة واضحة: كل طرف ينتج محتوى في تخصصه ولا أحد يترجم بين الثلاثة. والقرارات الآلية تُتخذ يوميًا بينما هذا الانفصال مستمر.

وبينما تستمر هذه الحال، تتصرف شركات التقنية الكبرى كسلطات تنظيمية موازية تضع معاييرها الخاصة لما هو مقبول وتفرضها من خلال شروط الاستخدام لا من خلال البرلمانات. OpenAI حين تُقرر أن محتوى ما “ضار” لا تسأل فقيهًا ولا مشرّعًا عربيًا. ومعاييرها تسري على مئات الملايين من المستخدمين المسلمين دون أن يكون لأي مؤسسة إسلامية دور في صياغتها أو حتى مراجعتها.

أن تملك بياناتك لا يعني أنك تملك قرارك إن كان من يُعالجها يشتغل بمنطق ثقافي وأخلاقي مختلف تمامًا عن سياقك. والمفارقة أن الفقه نفسه يملك مبدأً صريحًا يمنع هذا التسليم: أن القاضي لا يقضي بما لا يفهم. لكن هذا المبدأ يُردد في المحاضرات ولا أثر له في أي تشريع عربي نافذ.

ما الذي يمكن فعله الآن

ليس المطلوب فتوى فردية ولا بيان ختامي جديد. بل خطوات مؤسسية محددة لا تحتاج انتظار إجماع فقهي كامل ولا ميزانيات استثنائية بل إرادة سياسية وتشريعية واضحة.

حق الإخطار. كل شخص يتأثر بقرار آلي يجب أن يعرف أن القرار اتخذته خوارزمية لا إنسان. هذا لا يحتاج اجتهادًا فقهيًا معقدًا. يحتاج مادة قانونية واحدة تُضاف إلى قوانين حماية المستهلك أو قوانين العمل القائمة.

حق الاعتراض. ذلك المتقدم للوظيفة الذي رفضته الخوارزمية في بداية هذا المقال يجب أن يملك مسارًا قانونيًا يطعن من خلاله في القرار. ويجب أن يحصل على تفسير بلغة يفهمها لا بمعادلة رياضية. المراجعة البشرية ليست مِنّة من الشركة. هي حق للفرد.

تدقيق التحيّز قبل الإطلاق. كل نظام ذكاء اصطناعي يُستخدم في قطاع عام أو في خدمات تمس حقوق المواطنين يجب أن يخضع لفحص مستقل يكشف تحيزاته المضمّنة. ليس بعد سنة من تشغيله وتراكم الأضرار بل قبل أن يُصدر قراره الأول. وتقرير الفحص يجب أن يكون متاحًا للعموم لا محفوظًا في أدراج الشركة المشغّلة.

المراجعة البشرية الإلزامية. القرارات الآلية التي تمس الحقوق الأساسية كالتوظيف والإقراض والملاحقة الأمنية لا ينبغي أن تكون نهائية دون مراجعة إنسان مؤهّل يملك صلاحية نقضها. وهذا مبدأ يتقاطع مباشرة مع القاعدة الفقهية القائلة بأن الحكم لا يصدر إلا عن أهله. الأداة الفقهية موجودة. ما ينقص هو النص القانوني الذي يُفعّلها.

هيئة واحدة جامعة. فقهاء ومشرّعون ومهندسون تحت سقف واحد بصلاحيات تشريعية حقيقية لا استشارية. ليس مجمعًا يُصدر توصيات يقرأها المتخصصون ويتجاهلها صانع القرار، بل مؤسسة تُنتج معايير ملزمة وتملك أدوات إنفاذها. هذا هو الاجتهاد المؤسسي الذي يفرضه الواقع لا الاجتهاد الفردي الذي ينتهي بورقة أكاديمية.

من لا يكتب قانونه يعيش بقانون كُتب له.